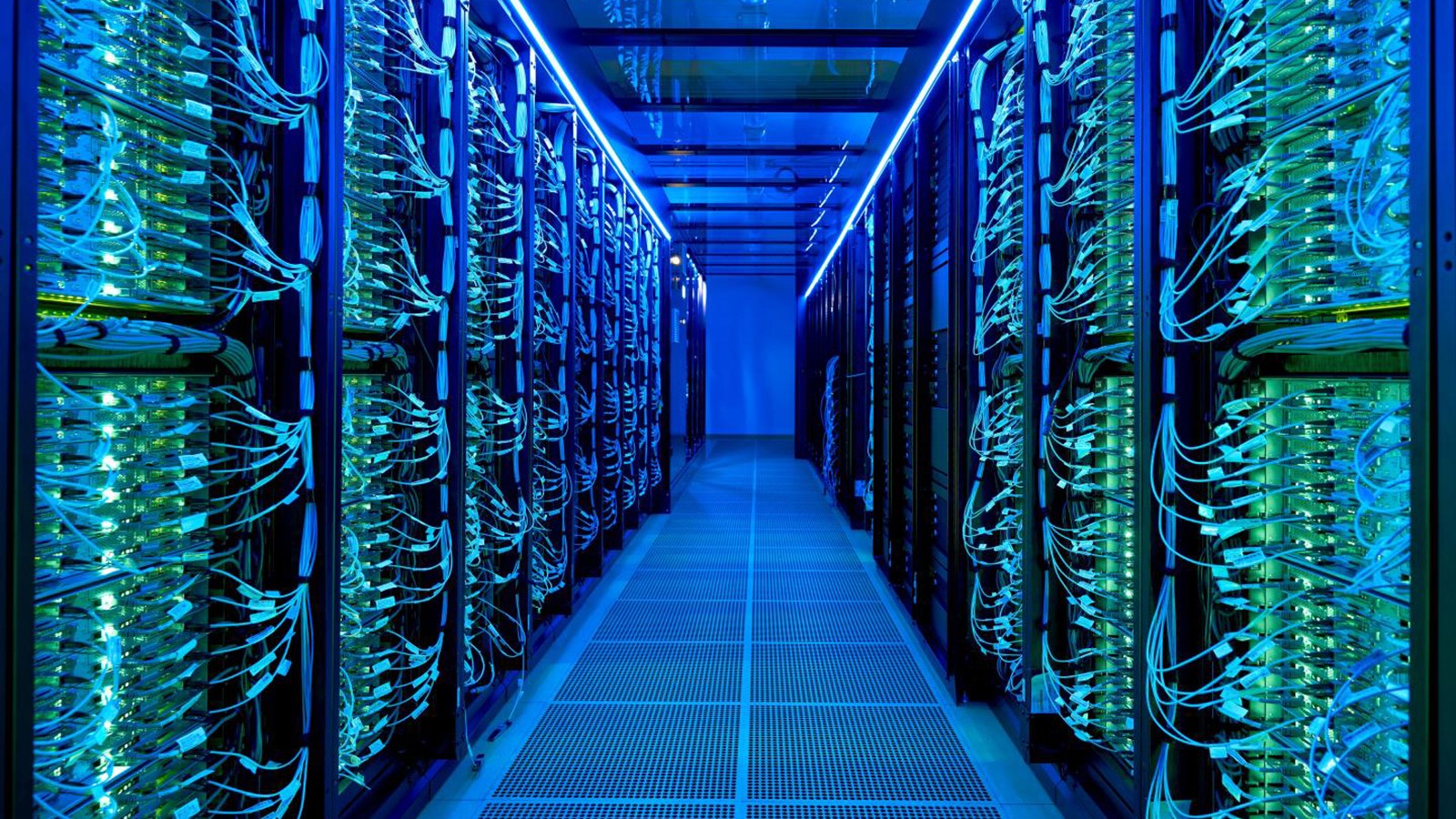

Sztuczna inteligencja, tak jak ta prawdziwa, wymaga treningu: niektóre algorytmy uczenia maszynowego mogą wymagać miesięcy, a nawet lat szkolenia. Meta chce przyspieszyć ten proces, za pośrednictwem superkomputera AI Research SuperCluster.

Konstrukcja jest na chwilę obecną wyposażona w 760 systemów Nvidia DGX A100, w których znajduje się łącznie 6080 kart graficznych Nvidia A100 – układy te są powszechnie wykorzystywane do trenowania sztucznej inteligencji. Meta zapowiada, że to jednak nie koniec rozbudowywania komputera. Jego konstrukcja zakończy się w tym roku, a gotowy AI Research SuperCluster będzie mógł się pochwalić aż 16 tysiącami aktywnych kart graficznych.

Superkomputer ma być odpowiedzialny za trenowanie najróżniejszych modeli sztucznej inteligencji: od algorytmów wykrywających szkodliwe treści i mowę nienawiści na Facebooku czy Instagramie, aż po funkcje rzeczywistości rozszerzonej i tworzenie rozwiązań dla metawersum. Przykładowo, AI Research SuperCluster ma współpracować z dziesiątkami języków w czasie rzeczywistym, co umożliwi osobom posługującym się różnymi dialektami, wspólnie grać lub uczestniczyć w wirtualnym spotkaniu bez problemów ze zrozumieniem drugiej strony.

Urządzenie jest już aktywne. Do szkolenia algorytmów, AI Research SuperCluster wykorzystuje dane użytkowników Meta, acz spółka zaznaczyła, że dane są zaszyfrowane i przechowywane poza dostępem do sieci. Firma szacuje, że superkomputer wielokrotnie skróci czas trenowania systemów uczenia maszynowego, poprawi ich dokładność oraz ułatwi tworzenie nowych, przyjaznych dla użytkowników rozwiązań.