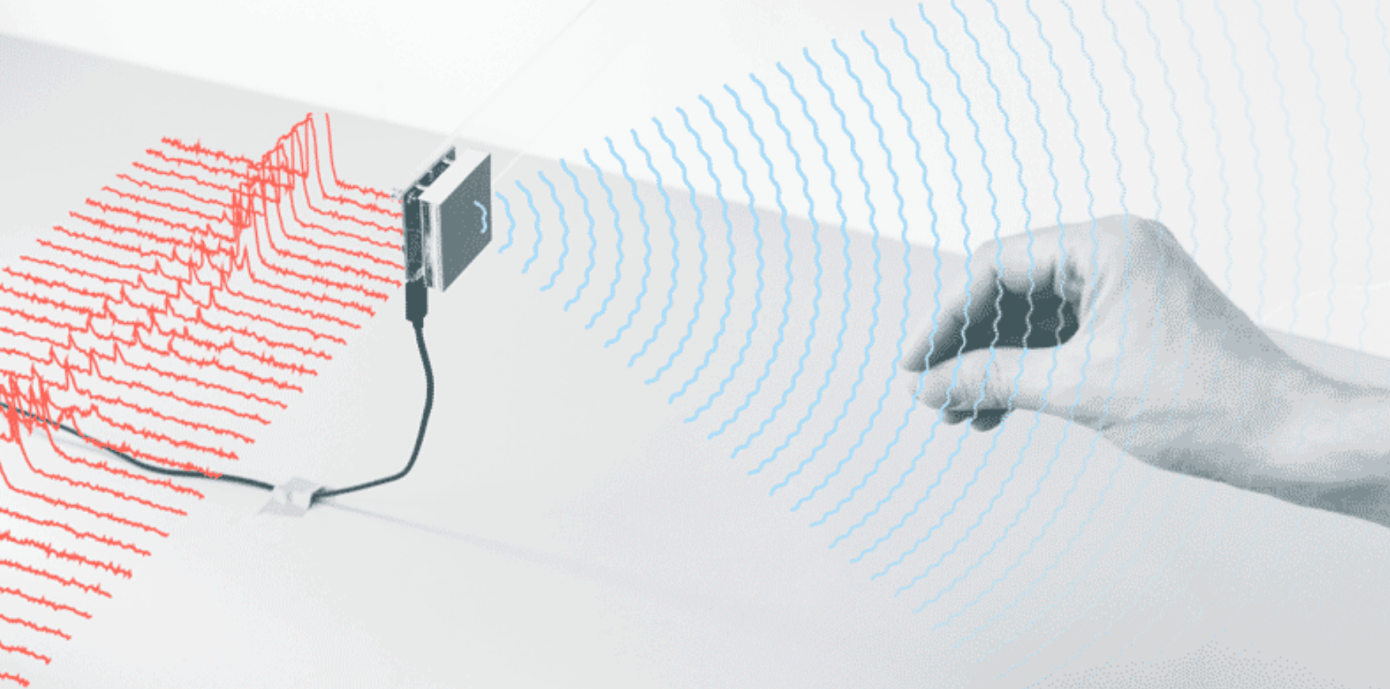

Sterowanie gestami na ekranach dotykowych to dobrze znana technologia, ale być może w przyszłości wyprze je zupełnie inny system gestów. Google otrzymało zielone światło na rozwój projektu Soli, który ma pozwolić na kontrolowanie urządzeń za pomocą ruchów wykonywanych… w powietrzu.

Soli po raz pierwszy został wspomniany podczas prezentacji na Google I/O 2015. Od tego czasu o programie nie słyszeliśmy zbyt często, ale był on ciągle rozwijany. Zasada działania technologii jest prosta i opiera się na wykorzystaniu niewielkich czipów radarowych. Przez większość czasu pozostają one uśpione, ale aktywują się po wykonaniu odpowiedniego gestu. Sensor „odczytuje” trójwymiarowy obraz ruchu dłoni i odpowiednio go interpretuje.

Ze względu na to, że Soli opiera się na wykorzystaniu części pasma 57 GHz – 64 GHz, wielu producentów korzystających z niego urządzeń obawiało się, że może ona przeszkadzać w transmisji sygnału. Wśród nich znalazł się Facebook, który w ramach Oculusa bada wykorzystanie podobnych technologii w urządzeniach VR. Sprawą musiała zająć się Federalna Komisja Łączności, która właśnie wydała oficjalną opinię, że interferencje emitowane przez Soli mieszczą się w granicach norm. Ponadto FCC zezwoliło na podwyższenie limitu mocy dla czujników. W oświadczeniu Komisja podkreśliła, że technologia może znacząco przyczynić się do poprawy jakości życia osób niepełnosprawnych.

Oznacza to, że praca nad sensorami Soli powinna nareszcie przyspieszyć, a możliwości czujników będą bardziej imponujące. Efekty starań Google zobaczymy w przyszłości – nie znamy żadnej konkretnej daty wprowadzenia technologii do użytku komercyjnego.